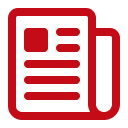

Mercado de memoria de alto ancho de banda: por producto (unidad central de procesamiento, matriz de puertas programables en campo, unidad de procesamiento gráfico, circuito integrado específico de la aplicación y otros); aplicación (computación de alto rendimiento [HPC], redes y espacio de cliente, centros de datos y otros); y dinámica de la región y la industria, tamaño del mercado y pronóstico de oportunidades para 2025-2033

- Última actualización: 30 de enero de 2025 | | ID del informe: AA0322178

Dinámica del mercado

Se prevé que el mercado de memoria de alto ancho de banda experimente un crecimiento significativo, con ingresos que aumentarán de US$ 501,0 millones en 2024 a US$ 5.810,5 millones en 2033, con una CAGR del 31,3 % durante el período de pronóstico 2025-2033.

La memoria de alto ancho de banda (HBM) se encuentra en el centro de los cambios transformadores en la potencia informática a partir de 2024. AMD presentó su serie MI300 con velocidades máximas de datos cercanas a los 5 terabytes por segundo en entornos de servidor cuidadosamente diseñados. SK hynix reveló un prototipo de HBM3 con una tasa de transferencia por pila de 819 gigabits por segundo en módulos HPC seleccionados. NVIDIA implementó HBM2E en GPUs insignia para centros de datos, alcanzando una frecuencia de memoria de 2,4 GHz en cargas de trabajo de IA específicas. Los laboratorios de HPC en Alemania informaron una mejora de la latencia de 21 nanosegundos con los nuevos paquetes HBM3, mientras que Samsung presentó una línea HBM a mediados de 2024 que ofrece 24 gigabits por capa para respaldar las aplicaciones emergentes de aprendizaje profundo. El impulso se aceleró aún más cuando la supercomputadora Leonardo en Italia adoptó 74 aceleradores AMD equipados con HBM integrado para simulaciones climáticas, cada uno con alrededor de 15 gigabytes de memoria avanzada para análisis en tiempo real.

Una startup de IA con sede en Tokio, especializada en el mercado de memoria de alto ancho de banda, aprovechó nueve GPU NVIDIA H100 con HBM2E para gestionar tareas expansivas de aprendizaje profundo. En una conferencia de HPC de 2024, se presentó un chip basado en HBM que alcanzaba los 2,78 terabytes por segundo en flujos de trabajo centrados en la memoria. Gracias al diseño de HBM, que reduce la energía por bit transferido, muchas empresas centradas en IA lo están adoptando para sus próximos proyectos de HPC. Este creciente interés en HBM se debe a su capacidad para superar los límites de memoria tradicionales en operaciones con uso intensivo de datos. Los investigadores observan avances significativos en simulaciones de fluidos, análisis genómico y otros escenarios que exigen un alto rendimiento constante. Anteriormente relegado a dispositivos de nicho, HBM ahora atrae una amplia atención por resolver problemas de regulación de voltaje, gestión térmica y eficiencia energética sin comprometer la velocidad. Los expertos del sector prevén una mayor optimización conjunta de hardware y software para que las capacidades de HBM se mantengan plenamente aprovechadas, lo que apunta a un futuro próximo de soluciones informáticas integradas y de bajo consumo. Estos desarrollos abren un camino en el que las interfaces de memoria avanzadas sirven como pilares esenciales para los avances de HPC de próxima generación, lo que garantiza que HBM mantenga su posición como un diferenciador clave en los mercados modernos basados en datos.

Para obtener más información, solicite una muestra gratuita

Expansión ultrarrápida de las líneas de producción

La capacidad de producción en el mercado global de memoria de alto ancho de banda ha aumentado en los últimos años, a medida que diversos fabricantes se esfuerzan por satisfacer la creciente demanda de soluciones de memoria avanzadas. Samsung planea aumentar su producción máxima de memoria de alto ancho de banda (HBM) a entre 150.000 y 170.000 unidades mensuales para el cuarto trimestre de 2024. Paralelamente, Micron pretende aumentar su capacidad de producción de HBM en su planta de Hiroshima a 25.000 unidades en el mismo plazo. Se prevé que la capacidad de producción combinada de los tres principales fabricantes (Samsung, SK Hynix y Micron) alcance aproximadamente las 540.000 unidades mensuales para 2025. El incesante impulso por ampliar la escala también se ve influenciado por la expansión de la infraestructura de centros de datos: solo Estados Unidos alberga 2.670 centros de datos, seguido del Reino Unido con 452 y Alemania con 443.

Para dar cabida a estos volúmenes crecientes, los principales actores del mercado de memoria de alto ancho de banda están modernizando sus instalaciones existentes y construyendo nuevas. Samsung está reforzando sus instalaciones de Pyeongtaek en Corea del Sur para escalar la producción de DDR5 y HBM, asegurando una cartera de productos más robusta para esta tecnología. Mientras tanto, SK Hynix continúa operando su línea de producción M16 en Icheon para HBM y también está construyendo una nueva planta de fabricación en Indiana, EE. UU., para producir stacks HBM personalizados para las GPU NVIDIA. Micron, por su parte, mantiene su compromiso de aumentar su capacidad de producción en su planta de Hiroshima en Japón, aprovechando la consolidada experiencia en fabricación de la región. Estas expansiones subrayan el esfuerzo conjunto de los líderes del mercado por mantenerse a la vanguardia tecnológica y satisfacer la creciente demanda global. Mediante amplias inversiones en infraestructura, las empresas están sentando las bases para una nueva era en la tecnología de memoria, impulsando una adopción más rápida en las industrias que dependen de la potencia computacional de vanguardia.

Dinámica del mercado

Conductor: Búsqueda incansable de velocidades de primer nivel para arquitecturas HPC especializadas con soluciones de memoria modernas integradas

La búsqueda incesante de velocidades de primer nivel para arquitecturas especializadas de HPC con soluciones de memoria modernas integradas surge de la necesidad constante de gestionar enormes volúmenes de datos y cálculos altamente complejos. Los principales fabricantes de chips en el mercado de memoria de alto ancho de banda han introducido nuevos módulos HBM específicamente diseñados para tareas como el modelado climático, los sistemas autónomos y las simulaciones cuánticas. Intel presentó un prototipo de acelerador en 2024 que demostró un rendimiento sostenido de 1,9 terabytes por segundo bajo inferencia de IA con uso intensivo de memoria. Los diseñadores de las instalaciones de HPC de Bangalore informaron que un enfoque basado en HBM redujo los tiempos de ejecución de simulación a 19 minutos para ciertos proyectos de dinámica de fluidos a gran escala. Graphcore confirmó que su IPU experimental con HBM podía procesar un millón de aristas de gráficos en 2 segundos bajo pruebas de cifrado especializadas. Estos avances enfatizan la urgencia del mercado por adoptar soluciones de memoria más rápidas y orientadas al ancho de banda que amplifiquen el rendimiento en clústeres de HPC.

Este afán por un rendimiento acelerado también se entrelaza con la aparición del encapsulado multimatriz, que permite una integración más flexible entre los componentes de computación y memoria. El nodo HPC recientemente desarrollado por Fujitsu aprovechó un subsistema HBM que transfirió 19 gigabytes de datos en un segundo de funcionamiento continuo, abriendo las puertas al análisis avanzado del plegamiento de proteínas. TSMC ha producido un intercalador especializado con microprotuberancias espaciadas a 30 micrómetros para facilitar las transferencias de señales ultrarrápidas en diseños basados en HBM. Otro caso destacable en el mercado de memoria de alto ancho de banda es el de un instituto de astrofísica francés que logró el análisis en tiempo real de datos de púlsares mediante un motor impulsado por HBM con una latencia media de 110 nanosegundos. Al refinar las interconexiones y optimizar las topologías de los sistemas, la industria garantiza que HBM siga siendo el núcleo del progreso de la HPC, impulsando eficazmente su adopción en el futuro previsible.

Tendencia: Creciente adopción de plataformas integradas de acelerador-memoria para potenciar el aprendizaje profundo avanzado y la sinergia de HPC

En el sector de la memoria de alto ancho de banda, una tendencia cada vez más visible es la creciente dependencia de diseños unificados de aceleradores y memoria que optimizan el flujo de datos para las cargas de trabajo de IA, HPC y edge. Los aceleradores Instinct de AMD incorporaron recientemente una solución HBM integrada que admite cálculos de alto rendimiento para modelado molecular en laboratorios suizos. Xilinx, ahora parte de AMD, presentó un prototipo de matriz de puertas programables en campo que ofrece un intercambio de datos casi instantáneo entre la lógica y HBM, lo que permite la ejecución simultánea de múltiples redes neuronales en el mercado de la memoria de alto ancho de banda. Cerebras ha demostrado un motor a escala de oblea, combinado con módulos HBM densos, para gestionar más de 2,5 millones de parámetros en tareas de aprendizaje de refuerzo sin transferencias fuera del chip. Esta alineación de aceleración y memoria de alta velocidad anuncia una nueva frontera en la eficiencia informática, impulsando soluciones avanzadas para industrias con uso intensivo de datos.

A medida que la industria evoluciona, los marcos y bibliotecas especializados se optimizan cada vez más para explotar canales de memoria estrechamente unidos. El clúster avanzado de HPC de OpenAI aplicó una arquitectura habilitada para HBM para realizar entrenamiento de modelos de lenguaje a gran escala con hasta 2 billones de tokens procesados en una sola ejecución continua. Otro hito significativo en el mercado de memoria de alto ancho de banda provino de investigadores en robótica con sede en Pekín, quienes aprovecharon la sinergia de HBM y computación GPU para lograr una toma de decisiones en submilisegundos en controladores humanoides. La división HPC de Alibaba Cloud informó que las instancias de HPC de próxima generación con HBM registraron una utilización de ancho de banda de 98 gigabytes por segundo en tareas basadas en cifrado. Estos ejemplos subrayan un cambio radical hacia ecosistemas integrados de acelerador-memoria, lo que marca una transición crucial en HPC e IA, a la vez que sienta las bases para futuros avances en el análisis de datos en tiempo real.

Desafío: Mitigar el estrés térmico en arquitecturas de matrices apiladas para problemas de estabilidad de memoria de ancho de banda alto y continuo

Un desafío importante en el mercado de memorias de alto ancho de banda consiste en controlar la acumulación de calor en capas de memoria densamente apiladas. Los fabricantes de chips observan que las tareas de HPC extendidas generan una acumulación térmica considerable, lo que afecta tanto la fiabilidad como el rendimiento. Un centro de simulación aeroespacial en Japón documentó temperaturas promedio de componentes HBM de 83 grados Celsius durante un análisis aerodinámico de varias horas. Para solucionar esto, Samsung creó un material de interfaz térmica especializado que reduce los niveles de calor en aproximadamente 8 grados en nodos HPC sometidos a pruebas rigurosas. Una agencia de investigación de defensa en Israel validó una configuración de refrigeración por agua que mantuvo un funcionamiento estable de la memoria durante al menos 72 horas continuas de procesamiento criptográfico. Estos hallazgos confirman que mitigar el calor sigue siendo una prioridad fundamental, garantizando que las estructuras apiladas no sufran limitaciones de rendimiento ni degradación de los componentes.

Las soluciones de gestión térmica en el mercado de memoria de alto ancho de banda también impactan el formato y la arquitectura general del sistema, dado que HBM se encuentra muy cerca de los recursos de cómputo. SK hynix presentó una variante de HBM2E que incorpora un canal de refrigeración de microcapa que transporta 1,1 litros de fluido por hora, mitigando los puntos calientes durante la inferencia de IA. Un consorcio estadounidense de HPC probó la tecnología de cámara de vapor junto a la pila de memoria, logrando un ancho de banda constante en cargas de trabajo extendidas, con conjuntos de datos de hasta 2,3 petabytes. Ingenieros de un instituto de investigación belga observaron que, sin refrigeración avanzada, las tasas de error de HBM aumentaron a 19 incidencias por millón de transacciones bajo parámetros de estrés. Superar estos obstáculos requiere ciencia de materiales innovadora, ingeniería de precisión y una sólida validación del sistema que, en conjunto, ayude a mantener un rendimiento estable en las exigentes implementaciones de HPC de próxima generación.

Análisis segmentario

Por producto: El predominio de las CPU se mantendrá hasta 2033

Las unidades centrales de procesamiento (CPU) ocupan una destacada cuota del 35,4 % en el mercado de memoria de alto ancho de banda gracias a su papel integrado en la orquestación de tareas computacionales complejas en ecosistemas de IA, analítica avanzada y computación de alto rendimiento (HPC). Al combinar HBM con CPU, las empresas obtienen capacidades de procesamiento de datos que superan los estándares de memoria convencionales, lo que permite más de un billón de operaciones de datos por minuto en ciertos entornos HPC. Cabe destacar que la arquitectura apilada en 3D de HBM admite hasta ocho módulos DRAM en una sola pila, cada uno conectado por canales duales para un flujo de datos sin obstáculos. En diseños de CPU de vanguardia, esta configuración se traduce en velocidades de transferencia máximas cercanas a 1 TB/s, lo que agiliza drásticamente tareas como el entrenamiento de modelos de aprendizaje automático. Además, algunas soluciones CPU-HBM de última generación incorporan anchos de bus de hasta 1024 bits, lo que permite la transmisión simultánea de más de 100 000 millones de bits de datos desde la memoria a la CPU casi en tiempo real. Estas características técnicas sustentan la relevancia de la CPU en este ámbito.

La creciente demanda de CPU equipadas con HBM en el mercado de memoria de alto ancho de banda también se debe a su papel en la reducción de la latencia y el consumo de energía en comparación con los sistemas de memoria paralela. En aplicaciones con uso intensivo de datos, una sola combinación de CPU y HBM puede mostrar mejoras en el ancho de banda de memoria de más del 40 % en comparación con las arquitecturas tradicionales basadas en DDR, lo que acelera enormemente los flujos de trabajo en la investigación científica y el modelado financiero. Otro punto a destacar cuantitativamente reside en la posible duplicación o triplicación de los cálculos de punto flotante una vez que HBM se integre estrechamente con las canalizaciones de la CPU principal, lo que aumenta el rendimiento computacional bruto del sistema. Esta sinergia alivia los cuellos de botella de memoria, evitando que los sistemas se queden sin memoria y garantizando que los datos críticos se alimenten a velocidades óptimas. Ante la grave escasez de suministro de HBM que se registra en toda la industria, los principales fabricantes de CPU están priorizando la integración de HBM para mantener métricas de rendimiento líderes en los procesadores de próxima generación. Estos factores, en conjunto, consolidan a las CPU como la categoría de producto líder que canaliza el excepcional ancho de banda y las capacidades de baja latencia de HBM en la informática moderna.

Aplicación: Los centros de datos como el mayor consumidor del mercado de memoria de alto ancho de banda

Los centros de datos han emergido como el mayor consumidor del mercado de memoria de alto ancho de banda con una participación en los ingresos de más del 38,4% gracias a los volúmenes explosivos de información procesada en la nube, la inferencia de IA y el análisis de hiperescala. En muchas instalaciones, los arquitectos de sistemas implementan diseños de servidores que integran HBM para soportar canalizaciones de consultas capaces de 500 millones de búsquedas en tiempo real por segundo, potenciando así las bases de datos de misión crítica y las redes de entrega de contenido. En ciertas configuraciones, cada rack de servidores puede contener múltiples tarjetas aceleradoras basadas en HBM, lo que permite un ancho de banda agregado que supera los 5 TB/s en implementaciones integrales. Mediante el uso de memoria apilada, los centros de datos también reducen la huella física de las soluciones de memoria hasta en un 30%, liberando espacio para potencia de procesamiento adicional. Con velocidades que alcanzan 1 TB/s por pila de HBM, las tareas masivas de procesamiento paralelo, como la transcodificación de video o el análisis en tiempo real a gran escala, se completan con mayor eficiencia y menores retrasos en el rendimiento.

Otro factor que contribuye a la adopción del mercado de memoria de alto ancho de banda en los centros de datos es el creciente énfasis en las cargas de trabajo impulsadas por IA, donde el entrenamiento de un único modelo de aprendizaje profundo puede implicar miles de millones de parámetros y requerir varios terabytes de ancho de banda de memoria en la operación diaria. Al aprovechar HBM en clústeres de servidores, las empresas han informado de operaciones de inferencia que se aceleran en más del 25 %, lo que reduce considerablemente los tiempos de procesamiento de datos en comparación con los sistemas convencionales basados en DRAM. Incluso aplicaciones exigentes como las bases de datos transaccionales experimentan un salto en el rendimiento de la memoria, con ciertas implementaciones que reducen las latencias de lectura-escritura en cinco microsegundos en comparación con las soluciones de memoria estándar. Además, HBM reduce la demanda de energía en grandes centros de datos en aproximadamente un 10 % por componente de memoria, lo que ahorra a las instalaciones decenas de miles de kilovatios-hora al año y respalda los objetivos generales de sostenibilidad.

Personaliza este informe + Valida con un experto

Acceda solo a las secciones que necesita: específicas de la región, de la empresa o por caso de uso.

Incluye una consulta gratuita con un experto en el dominio para ayudarle a orientar su decisión.

Para saber más sobre esta investigación: Solicite una muestra gratuita

Análisis regional: Asia Pacífico como el mayor mercado de memoria de alto ancho de banda

Asia Pacífico ocupa el primer puesto en el sector de memorias de alto ancho de banda, gracias a la confluencia de sólidas redes de fabricación, una sólida demanda de electrónica de consumo y un gran respaldo gubernamental a la I+D de semiconductores. Se prevé que la región crezca a una sólida tasa de crecimiento anual compuesta (TCAC) del 37,7 % en los próximos años. En 2022, la región generó más de 55,24 millones de dólares estadounidenses en ingresos, que alcanzarán los 198,20 millones de dólares estadounidenses en 2024. Esto demuestra que la región ha superado el dominio de Norteamérica en el mercado. En este sentido, algunos actores clave, como Samsung Electronics y SK Hynix, mantienen instalaciones de fabricación avanzadas que, en conjunto, producen millones de unidades HBM cada trimestre, lo que posiciona a la región como un centro neurálgico en la producción de memorias de vanguardia. Entre los países que impulsan este impulso, China, Corea del Sur y Japón cuentan con sofisticadas cadenas de suministro capaces de suministrar tecnología HBM tanto al mercado nacional como al global. En toda China, los incentivos políticos han impulsado el desarrollo de nuevas plantas de fabricación capaces de producir hasta 200.000 obleas de silicio al mes, una cifra que ha crecido de forma constante a medida que el país busca impulsar su autosuficiencia en componentes semiconductores. Mientras tanto, el liderazgo de Corea del Sur en la investigación de memorias y la capacidad de fabricación de precisión de Japón completan una tríada de fortalezas regionales. Esta combinación garantiza que Asia Pacífico siga siendo un centro neurálgico para los envíos de memorias a escala empresarial, impulsando el dominio de la región en la producción de HBM.

La demanda en el mercado de memoria de alto ancho de banda de Asia Pacífico surge del aumento de las cargas de trabajo de IA y las implementaciones de HPC en diversas industrias, desde la biotecnología hasta la conducción autónoma, que requieren módulos de memoria capaces de procesar más de 500 millones de transacciones de datos por segundo. Además, muchas de las mayores expansiones de centros de datos del mundo se están produciendo en APAC, donde los gigantes empresariales adoptan HBM para reducir el consumo energético entre 15 y 20 vatios por módulo en comparación con las interfaces de memoria típicas. China, en particular, se ha convertido en un líder estratégico al expandir los clústeres de HPC en sectores como la secuenciación genómica y la previsión meteorológica, lo que requiere soluciones de memoria extremadamente rápidas para tareas de simulación de datos. Las principales empresas, como Samsung, SK Hynix y las instalaciones regionales de Micron, perfeccionan continuamente tecnologías de última generación como HBM3E para mejorar las densidades de memoria y las velocidades de transferencia de datos, que alcanzarán los 1,4 TB/s en los próximos lanzamientos. Con extensas bases industriales de alta tecnología, APAC no solo satisface las necesidades nacionales sino que también envía grandes cantidades de HBM a nivel mundial, consolidando su lugar como la región preeminente en innovación y suministro de memoria de alto ancho de banda.

Principales empresas en el mercado de memoria de alto ancho de banda:

- Dispositivos micro avanzados, Inc.

- Samsung Electronics Co., Ltd.

- SK Hynix Inc.

- Tecnología Micron, Inc.

- Rambus.com

- Corporación Intel

- Xilinx Inc.

- Silicio abierto (SiFive)

- Corporación NEC

- Sistemas de diseño de cadencia, Inc.

- Otros jugadores destacados

Descripción general de la segmentación del mercado:

Por producto:

- Unidad central de procesamiento

- Matriz de puertas programables en campo

- Unidad de procesamiento de gráficos

- Circuito integrado de aplicación específica

- Otros

Por aplicación:

- Computación de alto rendimiento (HPC)

- Redes y espacio de cliente

- Centros de datos

- Otros

Por región:

- América del norte

- Estados Unidos.

- Canadá

- México

- Europa

- El Reino Unido

- Alemania

- Francia

- Italia

- España

- Polonia

- Rusia

- Resto de Europa

- Asia Pacífico

- Porcelana

- India

- Japón

- Australia y Nueva Zelanda

- ASEAN

- Resto de Asia Pacífico

- Oriente Medio y África (MEA)

- Emiratos Árabes Unidos

- Arabia Saudita

- Sudáfrica

- Resto de MEA

- Sudamerica

- Argentina

- Brasil

- Resto de Sudamérica

ALCANCE DEL INFORME

| Atributo del informe | Detalles |

|---|---|

| Valor del tamaño del mercado en 2024 | US$ 501,0 millones |

| Ingresos esperados en 2033 | US$ 5.810,5 millones |

| Datos históricos | 2020-2023 |

| Año base | 2024 |

| Período de pronóstico | 2025-2033 |

| Unidad | Valor (USD millones) |

| Tasa de crecimiento anual compuesta (TCAC) | 31.3% |

| Segmentos cubiertos | Por producto, por aplicación, por región |

| Empresas clave | Advanced Micro Devices, Inc., Samsung Electronics Co., Ltd., SK Hynix Inc., Micron Technology, Inc., Rambus.com, Intel Corporation, Xilinx Inc., Open-Silicon (SiFive), NEC Corporation, Cadence Design Systems, Inc. y otras empresas destacadas |

| Alcance de personalización | Obtenga su informe personalizado según sus preferencias. Solicite personalización. |

¿BUSCA UN CONOCIMIENTO INTEGRAL DEL MERCADO? CONTACTE CON NUESTROS ESPECIALISTAS.

HABLE CON UN ANALISTA

.svg)